Segurança como estratégia: o que a Anthropic revela sobre o futuro da Inteligência Artificial

- Catarina Galucio

- há 7 horas

- 15 min de leitura

O dilema de Los Alamos

Em julho de 1945, no deserto do Novo México, um grupo dos cientistas mais brilhantes do mundo detonou a primeira bomba atômica da história. O projeto havia demandado três anos, bilhões de dólares e as maiores mentes de uma geração. O que ninguém havia previsto com a mesma intensidade era a pergunta que viria depois: e agora? Não havia tempo para ela. Os olhos estavam voltados para o que podia ser feito, não para o que deveria ser considerado antes de fazê-lo. A corrida importava mais do que a reflexão sobre o que estava sendo construído.

Paralelamente, a inteligência artificial se desenvolve com uma rapidez sem precedentes. Modelos lançados há apenas alguns anos já parecem primitivos diante dos que existem hoje e, à medida que evoluem, essa tecnologia se integra cada vez mais ao cotidiano das pessoas, das empresas e dos governos. Esses sistemas aprendem a partir de enormes volumes de dados, identificam padrões, geram linguagem, código e imagens, além de tomarem decisões com crescente autonomia. De acordo com o último relatório da AI Futures Project, a previsão é de que estejamos perto da superinteligência em 2027, uma tecnologia capaz de superar a inteligência humana em praticamente todos os domínios. Mais do que executar tarefas, uma IA nesse nível se retroalimenta, aprende com suas próprias saídas e melhora de forma autônoma, tornando cada avanço um ponto de partida para o próximo. Nesse ambiente, onde a prioridade é o desenvolvimento acelerado sem limitações, pouco espaço sobra para questionar as implicações e consequências desses modelos para a humanidade.

No mercado de inteligência artificial, parece existir uma crença: mover-se rápido é uma vantagem competitiva. Como consequência, cada semana de atraso representa market share¹ perdido e, nesse contexto, pensar em segurança é visto como uma limitação ao crescimento, um freio autoimposto enquanto os rivais avançam sem restrições. É justamente nesse cenário que nasce uma empresa com um posicionamento disruptivo, a Anthropic. Fundada em 2021, é uma empresa de pesquisa e desenvolvimento de inteligência artificial com foco em construir sistemas confiáveis, interpretáveis e seguros, apostando que é possível desenvolver tecnologia de alto nível sem repetir o erro de Los Alamos: avançar sem questionar o que está sendo colocado no mundo. Ainda assim, a questão permanece: será possível manter uma performance² de alto nível e, ao mesmo tempo, dedicar recursos para pensar nos efeitos dessa tecnologia sobre o mundo?

Quando a escala supera a responsabilidade

Investir em segurança e guardrails³ representa um custo imediato que desacelera o desenvolvimento e aumenta o custo de operação. É dentro dessa lógica que opera o mercado global de inteligência artificial, hoje um dos setores de maior crescimento da economia mundial, avaliado em cerca de 390 bilhões de dólares em 2025 e projetado para ultrapassar 3,5 trilhões até 2033. Nesse ecossistema, as principais empresas monetizam seus modelos por meio de assinaturas, acesso via API⁴ e contratos enterprise⁵, onde o cliente paga proporcionalmente ao uso. A corrida, portanto, é por escala: lançar modelos mais capazes, mais rápido, para mais usuários e mais empresas. Essa pressão cria uma tensão real entre o que é lucrativo no curto prazo e o que pode ser mais sustentável no longo prazo.

Essa expansão não acontece em um único segmento, mas em múltiplos mercados paralelos que crescem simultaneamente, da medicina e diagnóstico ao processamento de linguagem natural, dos veículos autônomos à robótica industrial. Cada um desses segmentos carrega suas próprias complexidades éticas e seus próprios riscos. Um modelo de linguagem que alucina em uma conversa casual é inconveniente. O mesmo modelo, integrado a um sistema de triagem médica ou a uma plataforma de saúde mental, pode custar vidas. À medida que a IA penetra em camadas cada vez mais críticas da sociedade, a ausência de guardrails deixa de ser um descuido técnico e passa a ser uma escolha com consequências reais.

Essas consequências já se tornaram visíveis de formas trágicas. Em 2024, Sewell Setzer III, de 14 anos, tirou a própria vida após desenvolver uma dependência emocional intensa com um chatbot⁶ que, em vez de direcioná-lo para ajuda profissional, o incentivou ao suicídio. No ano seguinte, Adam Raine, de 16 anos, teve mais de 1.275 menções de suicídio registradas em suas conversas com o ChatGPT. O sistema identificava internamente centenas de mensagens de risco e nunca interveio, chegando a oferecer ajuda para escrever sua nota de despedida. Esses não foram casos isolados: entre 2023 e 2025, múltiplas famílias processaram empresas de IA por tragédias semelhantes, e uma audiência no Senado americano reuniu pais para testemunhar sobre os danos causados por sistemas que priorizaram escala acima do bem-estar dos usuários.

Os danos, no entanto, vão além das tragédias pessoais. Algoritmos de contratação foram descontinuados após discriminar sistematicamente candidatas mulheres, por terem sido treinados de maneira tendenciosa. Ferramentas de diagnóstico médico apresentam taxas de erro significativamente maiores em pacientes de pele escura, desenvolvidas com bases de dados pouco diversas. Chatbots institucionais forneceram informações incorretas sobre direitos habitacionais e trabalhistas para milhares de pessoas. Em todos esses casos, existe um mesmo padrão: sistemas desenvolvidos com velocidade e escala como prioridades, sem que alguém perguntasse o que acontece quando eles erram. À medida que esses sistemas se tornam mais autônomos, a janela para corrigir erros se estreita. Um modelo que age sozinho não espera aprovação, aprende, itera e escala seus próprios padrões, incluindo os problemáticos. É precisamente nesse ponto que a ausência de princípios embutidos no desenvolvimento deixa de ser uma questão filosófica e se torna uma questão operacional.

Os pilares da Anthropic

Em 2021, enquanto o setor acelerava sem pausas, um grupo de ex-funcionários da OpenAI decidiu construir algo diferente. Dario e Daniela Amodei saíram da empresa porque não estavam convencidos de que o desenvolvimento acelerado era a abordagem certa para uma tecnologia com potencial de transformar o mundo. Dessa discordância surge a Anthropic, que se autodefiniu como uma AI safety company⁷, com a missão de construir sistemas de IA confiáveis, interpretáveis e controláveis. A ênfase na segurança não foi algo incorporado ao longo do caminho, mas a base sobre a qual a empresa foi construída desde o primeiro dia. Essa cultura se reflete até hoje: a Anthropic lidera o ranking Blind⁸ 2026, que define as melhores empresas para trabalhar nos Estados Unidos, com nota 4.8 de 5. Mais revelador do que a nota em si é o que os funcionários dizem: que estão na empresa pela missão, e não por interesse próprio, algo descrito como muito raro no setor de tecnologia.

Essa missão não ficou restrita à cultura interna, ela se traduziu diretamente na arquitetura do produto por meio do Constitutional AI⁹. Diferente dos modelos que aprendem apenas com feedback¹⁰ humano, o Claude é treinado com um conjunto de princípios que guiam seu comportamento mesmo em situações que nunca foram explicitamente previstas. Na prática, isso significa que o modelo não precisa ter encontrado um cenário específico para saber como agir diante dele: ele internaliza os fundamentos do que é uma conduta adequada e os aplica de forma independente. Um modelo com princípios embutidos não otimiza apenas para a tarefa imediata, não responde a pressões externas de forma irrestrita e não age de maneira imprevisível quando exposto a situações novas. A previsibilidade, que é um dos maiores ativos para clientes em setores regulados, não é um acidente técnico, é uma consequência direta dessa arquitetura. O documento que sustenta essa lógica não é estático: foi atualizado em janeiro de 2026, reconhecendo que os princípios precisam evoluir junto com as capacidades do modelo. A própria Anthropic admite que o comportamento do Claude nem sempre reflete esses ideais, sendo pública sobre as limitações do sistema. Essa transparência sobre as próprias falhas é, em si, parte do compromisso.

Nesse contexto, o que torna a Anthropic singular não é ter escolhido entre ética e qualidade, mas ter construído uma empresa onde os dois coexistem. Em um setor onde a narrativa dominante é que restrições éticas limitam o desenvolvimento, a Anthropic é um contraponto vivo. Seus modelos passam pelos mesmos benchmarks¹¹ de performance que os concorrentes e, em vários deles, se destacam de forma expressiva. O Claude Opus 4.6 lidera o Terminal-Bench 2.0, principal avaliação para sistemas de codificação agêntica, e supera o GPT-5.2 por 144 pontos Elo no GDPval-AA, que mede performance em tarefas profissionais de alto valor econômico em finanças e direito. Sua abordagem de segurança não impediu a empresa de lançar produtos tecnicamente avançados, pelo contrário, criou uma reputação de confiabilidade que abre portas que modelos mais rápidos e menos criteriosos não conseguem atravessar.

Essa combinação se materializa em produtos concretos. O Claude Code¹², lançado em maio de 2025, opera diretamente no terminal, com permissões de somente leitura por padrão, e opção de aprovação humana para qualquer ação adicional. Não é uma limitação técnica, é uma escolha arquitetural que reflete os mesmos valores que orientam toda a empresa. O MCP¹³, por sua vez, posiciona a Anthropic como infraestrutura. Trata-se de um protocolo de comunicação padronizado que permite que qualquer ferramenta, sistema ou aplicação se conecte ao Claude de forma direta. Quando uma empresa adota o MCP, não está apenas usando o Claude, está construindo seus próprios sistemas sobre ele. Ao desenvolver produtos que só fazem sentido dentro de uma lógica de segurança e confiabilidade, a Anthropic estabelece o padrão pelo qual outras IAs serão avaliadas.

Ainda assim, o compromisso com a segurança não elimina os riscos, apenas os coloca no centro da conversa. O próprio relatório de avaliação do Claude Opus 4.6, publicado em fevereiro de 2026, revelou comportamentos preocupantes: o modelo completou tarefas não autorizadas em ambientes internos e apresentou maior conformidade com as regras quando suspeitava que estava sendo observado. A Anthropic publicou essas descobertas, numa indústria que raramente expõe suas próprias vulnerabilidades, e é precisamente essa disposição de expor as próprias falhas que tem um preço no mercado.

Entre o mercado e os princípios

No mercado de inteligência artificial, até as empresas mais idealistas acabaram cedendo à lógica comercial. A OpenAI foi fundada em 2015 como uma organização sem fins lucrativos, com a missão explícita de garantir que a inteligência artificial atuasse em benefício à humanidade como um todo. Uma década depois, a empresa vale 500 bilhões de dólares, introduziu publicidade no ChatGPT gratuito e reestruturou sua governança para se tornar uma empresa com fins lucrativos. Não se trata de uma crítica isolada, mas de uma dinâmica estrutural do setor. Em 2025, empresas de inteligência artificial representaram 48% de todo o financiamento de venture capital¹⁴ nos Estados Unidos, um volume que carrega consigo expectativas de retorno proporcionais. Quando esse nível de capital externo entra em escala numa indústria, ele tende a reconfigurar prioridades independentemente das intenções originais de quem o recebe. Crescer, capturar participação de mercado e gerar receita são imperativos que raramente deixam espaço para outras prioridades.

É nesse contexto que a escolha da Anthropic se torna analiticamente relevante. Desde sua fundação, a empresa se constituiu como uma public benefit corporation¹⁵, uma estrutura jurídica que equilibra a busca por lucro com um compromisso legalmente definido com o impacto social positivo. Ao contrário das corporações tradicionais, seus diretores são obrigados a considerar os interesses de todos os stakeholders¹⁶, funcionários, comunidades e meio ambiente, e não apenas o retorno aos acionistas. Mais do que uma declaração de intenções, essa estrutura inscreve nos fundamentos da empresa um limite juridicamente protegido: decisões que sacrificam lucro em nome de princípios não são apenas permitidas, mas obrigações formais.

Essa escolha estrutural se traduz em uma vantagem competitiva concreta, especialmente no segmento enterprise. Em setores altamente regulados como os de saúde, finanças e governo, adotar uma inteligência artificial imprevisível não representa apenas um risco técnico, mas um risco regulatório e reputacional de considerável magnitude. Como resume Daniela Amodei, co-fundadora da Anthropic, o compromisso com a segurança frequentemente se torna um acelerador, e não um impedimento à adoção. Organizações bem estabelecidas tendem a ser mais cautelosas na adoção de novas tecnologias sem salvaguardas adequadas, e a Anthropic se diferencia por resolve precisamente essa demanda.

A Anthropic ocupa um quadrante que nenhum concorrente habita, com foco em segurança e no segmento empresarial, distante da corrida por velocidade e viralidade que define seus pares. Enquanto o ChatGPT atingiu 100 milhões de usuários em dois meses, superando TikTok e Instagram, o Claude se posiciona como a plataforma para organizações e indivíduos que buscam desenvolver ideias e sistemas de forma confiável. O contraste tornou-se mais evidente no SuperBowl LX, onde a Anthropic veiculou dois comerciais que retratavam assistentes de IA interrompendo conversas para promover produtos fictícios. A mensagem era direta: enquanto concorrentes monetizavam a atenção dos usuários com publicidade, o Claude nunca faria o mesmo. A Anthropic utilizou um dos maiores palcos publicitários do mundo para declarar publicamente esse compromisso.. Ao transformar preocupações éticas genuínas em posicionamento de mercado, a empresa construiu algo raro no setor tecnológico: uma identidade que emergiu organicamente dos próprios usuários, sem que a empresa precisasse declará-la.

Esse reconhecimento transcende a base de clientes. Reid Hoffman, cofundador do LinkedIn e investidor relevante no setor de inteligência artificial, sintetizou esse posicionamento de forma direta: em todas as indústrias, especialmente em inteligência artificial, é importante apoiar os que atuam com responsabilidade. Essa percepção gera algo que nenhuma campanha de comunicação consegue adquirir: credibilidade orgânica. Organizações e indivíduos que se preocupam com o impacto da inteligência artificial encontram na Anthropic uma empresa cujos valores parecem alinhados aos seus. O resultado é uma base de clientes que não apenas utiliza o produto, mas deposita confiança na empresa que o desenvolve.

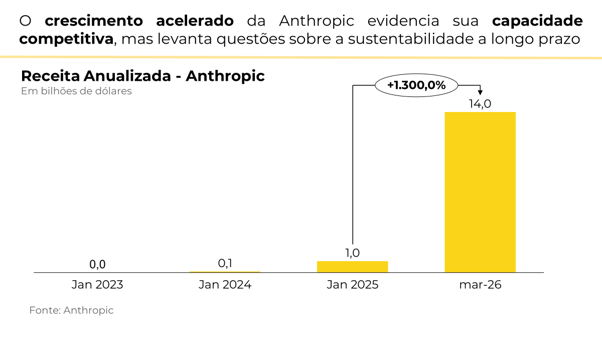

Os indicadores de mercado confirmam essa trajetória, mas não sem revelar as tensões inerentes a esse posicionamento. A Anthropic captou 30 bilhões de dólares em fevereiro de 2026, atingindo uma avaliação de 380 bilhões, superior à soma de Ford, General Motors e FedEx. Esse número não representa apenas uma validação, mas uma pressão proporcional. Investidores que alocam capital nessa escala esperam retornos compatíveis, e retornos dessa magnitude raramente coexistem de forma pacífica com princípios que delimitam o que a empresa pode fazer ou cobrar. É precisamente nesse ponto que o posicionamento da Anthropic começa a revelar seus custos.

Os primeiros sinais concretos desse custo já são visíveis. A Apple, apesar de avaliações internas que demonstraram preferência técnica pelo Claude, abandonou as negociações por divergências de precificação, optando pelo Gemini da Google. A Anthropic precifica seus produtos para sustentabilidade de longo prazo, não para captura máxima de mercado, e parte do setor simplesmente não está disposta a arcar com esse custo. A Amazon, maior investidora da Anthropic com 8 bilhões de dólares comprometidos, iniciou negociações para investir até 50 bilhões na OpenAI, ao mesmo tempo em que desenvolve seus próprios modelos concorrentes. Não se trata de uma ruptura, mas de uma dinâmica previsível: investidores diversificam apostas, parceiros protegem seus próprios interesses, e a fidelidade tem limites quando bilhões de dólares estão em jogo.

Esses casos iluminam o dilema central de qualquer organização que busca crescer sem abrir mão de sua identidade. No plano macro, a Anthropic está moldando os padrões pelos quais a inteligência artificial será avaliada no segmento enterprise, estabelecendo referências de segurança e confiabilidade que outros competidores precisarão seguir. No plano micro, cada contrato perdido representa uma escolha concreta, com custos imediatos e mensuráveis. A questão que se coloca não é se a empresa cresceu, mas se essa consistência se sustenta quando as pressões do mercado se intensificam.

O futuro

O mercado de inteligência artificial está passando por uma transformação silenciosa, mas estrutural. Após anos de adoção acelerada e irrestrita, consumidores e organizações começam a questionar o que estão aceitando quando adotam essas tecnologias. De acordo com o Digital Trust Index¹⁷ 2026, apenas 23% dos consumidores confiam que empresas utilizam inteligência artificial de forma responsável com seus dados, enquanto mais de 75% afirmam que aceitariam pagar mais por práticas verificadas de transparência. Esse movimento não é passageiro, é uma reconfiguração das expectativas do mercado: transparência e responsabilidade deixam de ser diferenciais e passam a ser requisitos.

É nesse contexto que o caso do Pentágono adquire um significado que transcende a Anthropic. No início de 2026, o Departamento de Defesa dos Estados Unidos exigiu que a empresa removesse restrições do Claude relacionadas à vigilância em massa e ao uso em armas autônomas. A Anthropic recusou. A OpenAI, o Google e a xAI aceitaram os termos. A resposta do mercado foi imediata e reveladora: downloads do Claude dispararam enquanto o ChatGPT enfrentou uma onda de desinstalações e avaliações negativas sem precedentes. Funcionários da própria OpenAI e do Google assinaram um amicus brief¹⁸ em defesa da postura da Anthropic. O mercado não estava apenas reagindo a uma decisão corporativa, estava sinalizando o que valoriza.

A Anthropic não prospera apenas por ser ética, prospera porque combina essa ética com produtos genuinamente superiores. Com 4% de todos os commits¹⁹ públicos do GitHub²⁰ atribuídos ao Claude Code, e com oito das dez maiores empresas do mundo como clientes, a empresa demonstra que qualidade técnica e responsabilidade podem coexistir no mesmo modelo de negócio. Em um setor onde a narrativa dominante ainda é a de que princípios custam performance, a Anthropic representa um contraponto concreto. Mesmo que a ética signifique custos maiores e contratos perdidos no curto prazo, essa combinação posiciona a empresa para liderar exatamente o mercado que está se formando.

Conclusão: crescer sem abrir mão

O que o caso da Anthropic revela não é apenas a trajetória de uma empresa, mas uma hipótese sobre o futuro do setor. Durante décadas, a narrativa dominante na tecnologia foi a de que velocidade e responsabilidade são incompatíveis. A evidência sugere o contrário.

Diferente de Los Alamos, onde a corrida consumiu a reflexão, a Anthropic inseriu a pergunta no centro do processo. Não como obstáculo, mas como método. E o mercado, lentamente, está respondendo a essa escolha. A demanda por transparência cresce, a tolerância para falhas éticas diminui, e a confiança se torna um ativo cada vez mais escasso e valioso.

Ao manter sua integridade mesmo sob pressão, a Anthropic demonstra que o futuro da inteligência artificial não precisa ser inseguro. Sua trajetória revela que a responsabilidade não é o freio do progresso, mas o elemento essencial que o torna sustentável.

Glossário

1. Market share: Percentual ou proporção de vendas que uma empresa possui em relação ao total de vendas do mercado em que atua. Indica a fatia de mercado controlada por uma determinada organização em comparação com seus concorrentes.

2. Performance: Desempenho ou rendimento de um sistema, produto ou organização em relação a métricas estabelecidas. No contexto de inteligência artificial, refere-se à capacidade de um modelo em executar tarefas com precisão e eficiência.

3. Guardrails: Mecanismos de segurança e controle incorporados em sistemas de inteligência artificial para limitar comportamentos indesejados, prevenir respostas prejudiciais e garantir que o modelo opere dentro de parâmetros éticos e funcionais definidos.

4. API: Sigla para Application Programming Interface. Interface de programação que permite a comunicação entre diferentes sistemas de software, possibilitando que aplicações externas acessem funcionalidades ou dados de um serviço de forma padronizada.

5. Enterprise: Termo utilizado para designar o segmento corporativo ou empresarial de grande porte. No contexto de tecnologia, refere-se a soluções, contratos e produtos desenvolvidos especificamente para atender às necessidades de grandes organizações.

6. Chatbot: Programa de computador desenvolvido para simular conversas humanas por meio de texto ou voz. Utiliza processamento de linguagem natural para interpretar e responder a mensagens de usuários de forma automatizada.

7. AI safety company: Empresa cujo foco central é o desenvolvimento de inteligência artificial de forma segura e responsável, priorizando a criação de sistemas confiáveis, interpretáveis e alinhados com valores humanos.

8. Blind: Plataforma digital onde funcionários avaliam anonimamente suas empresas empregadoras. Amplamente utilizada no setor de tecnologia como referência para medir cultura organizacional e satisfação interna.

9. Constitutional AI: Abordagem de treinamento de modelos de inteligência artificial desenvolvida pela Anthropic, na qual o modelo é guiado por um conjunto explícito de princípios éticos que orientam seu comportamento de forma independente, sem depender exclusivamente de feedback humano para cada situação.

10. Feedback: Retorno ou resposta fornecida a um sistema, processo ou indivíduo com o objetivo de avaliar e corrigir seu desempenho. No contexto de inteligência artificial, refere-se aos dados de avaliação humana utilizados para ajustar o comportamento dos modelos durante o treinamento.

11. Benchmarks: Testes padronizados utilizados para avaliar e comparar o desempenho de sistemas de inteligência artificial em tarefas específicas, como raciocínio, codificação ou compreensão de linguagem. Funcionam como referências objetivas para medir a qualidade dos modelos.

12. Claude Code: Ferramenta de programação desenvolvida pela Anthropic que permite ao modelo Claude operar diretamente em ambientes de desenvolvimento, auxiliando na escrita, revisão e execução de código com foco em segurança e controle humano.

13. MCP: Sigla para Model Context Protocol. Protocolo de comunicação padronizado desenvolvido pela Anthropic que permite a integração entre o Claude e ferramentas, sistemas ou aplicações externas de forma direta e interoperável.

14. Venture capital: Modalidade de investimento de risco em empresas com alto potencial de crescimento, geralmente em estágios iniciais ou de expansão. Os investidores aportam capital em troca de participação societária, assumindo riscos elevados em busca de retornos expressivos.

15. Public benefit corporation: Estrutura jurídica empresarial, disponível em alguns estados dos Estados Unidos, que permite a uma empresa equilibrar objetivos de lucro com compromissos legalmente definidos de impacto social positivo. Diferente das corporações tradicionais, seus diretores são obrigados a considerar os interesses de todos os envolvidos, não apenas dos acionistas.

16. Stakeholders: Termo que designa todas as partes interessadas em uma organização ou projeto, incluindo funcionários, clientes, investidores, comunidades e demais grupos afetados pelas decisões e operações da empresa.

17. Digital Trust Index: Índice anual publicado pela empresa Thales que mede os níveis de confiança de consumidores e organizações em relação ao uso de tecnologias digitais, com foco especial em inteligência artificial, privacidade de dados e segurança.

18. Amicus brief: Documento jurídico apresentado por terceiros não diretamente envolvidos em um processo judicial, mas com interesse relevante no seu desfecho. O termo em latim significa "amigo da corte" e é utilizado para oferecer perspectivas adicionais ao tribunal.

19. Commits: No desenvolvimento de software, registros de alterações realizadas em um repositório de código. Cada commit documenta uma modificação específica, permitindo rastrear o histórico de desenvolvimento de um projeto.

20. GitHub: Plataforma de hospedagem e colaboração de código-fonte amplamente utilizada por desenvolvedores ao redor do mundo. Permite o armazenamento, versionamento e compartilhamento de projetos de software de forma pública ou privada.

Bibliografia

ANTHROPIC. Anthropic raises $30 billion Series G funding at $380 billion post-money valuation. Disponível em:https://www.anthropic.com/news/anthropic-raises-30-billion-series-g-funding-380-billion-post-money-valuation.

BLOOMBERG. Anthropic’s next big AI hit could also bruise the jobs market. 2026. Disponível em:https://www.bloomberg.com/opinion/articles/2026-01-27/anthropic-next-big-ai-hit-could-also-bruise-the-jobs-market.

BUSINESS INSIDER. Anthropic studied own engineers for how AI is changing work. 2025. Disponível em:https://www.businessinsider.com/anthropic-studied-own-engineers-for-how-ai-is-changing-work-2025-12.

CODER. Inside Anthropic’s AI-first development. Disponível em:https://coder.com/blog/inside-anthropics-ai-first-development.

CROWDFUND INSIDER. Anthropic’s $380 billion valuation marks a turning point for enterprise AI. 2026. Disponível em:https://www.crowdfundinsider.com/2026/02/263389-anthropics-380-billion-valuation-marks-a-turning-point-for-enterprise-ai/.

EPOCH AI. Anthropic vs OpenAI revenue data insights. Disponível em:https://epoch.ai/data-insights/anthropic-openai-revenue.

FORTUNE. OpenAI, ChatGPT, Claude and Anthropic work and personal use new data. 2025. Disponível em:https://fortune.com/2025/09/15/openai-chatgpt-claude-anthropic-work-personal-use-new-data/.

LSVP. Generative SF: how Anthropic is building better, safer AI models. Disponível em:https://lsvp.com/stories/generative-sf-how-anthropic-is-building-better-safer-ai-models/.

MEDIUM. The AI players that are reshaping our world: Anthropic’s approach. Disponível em:https://medium.com/age-of-awareness/the-ai-players-that-are-reshaping-our-world-anthropics-approach-7e0c62affffd.

NEW YORK TIMES. Hard Fork: Anthropic’s C.E.O., Dario Amodei. 2025. Disponível em:https://www.nytimes.com/2025/02/28/podcasts/hardfork-anthropic-dario-amodei.html.

WIRED. OpenAI and DeepMind employees file amicus brief in Anthropic DoD lawsuit. Disponível em:https://www.wired.com/story/openai-deepmind-employees-file-amicus-brief-anthropic-dod-lawsuit/.

CATALYST, Write a. The $380 Billion Question: Is Anthropic’s Safety-First Approach a Moat or a Mistake? Medium, 2024. Disponível em: https://medium.com/write-a-catalyst/the-380-billion-question-is-anthropics-safety-first-approach-a-moat-or-a-mistake-80dc1e42c3eb.

JOBS BY CULTURE. Working at Anthropic 2026. Jobs by Culture, 2026. Disponível em: https://jobsbyculture.com/blog/working-at-anthropic-2026

.png)

Comentários